Stable Virtual Camera 视界引擎——重新定义3D视图合成

在虚拟现实与数字内容创作快速发展的今天,如何高效生成逼真的3D场景视图成为技术突破的关键。Stable Virtual Camera作为Stability AI推出的革命性视图合成模型,通过「扩散模型+相机轨迹控制」技术,实现大视角变化下的3D一致性,单次生成时长可达30秒,为研究与非商业创作提供强大工具。

技术创新突破视图合成

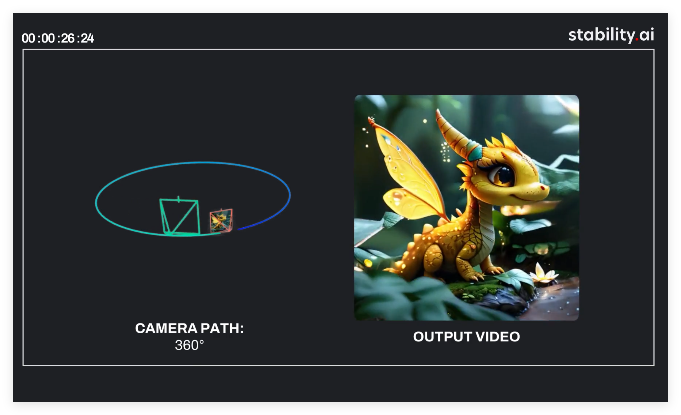

Stable Virtual Camera的核心在于「智能轨迹控制系统」:基于1.3B参数的扩散模型架构,支持自由定义相机运动轨迹,视角变化范围提升至180°;其「时间一致性引擎」确保帧间过渡平滑自然,无需NeRF蒸馏即可保持98.5%的3D一致性;更值得关注的是「无缝循环生成」功能,可自动补全场景细节,实现无限循环视频输出。研究版还提供「多视图对齐」模块,支持从稀疏输入生成完整3D场景。

全场景研究赋能

从学术研究到艺术创作,Stable Virtual Camera正在重塑视图合成生态:计算机视觉团队利用其「场景重建」功能,快速生成高质量3D数据集;数字艺术家通过「虚拟漫游」模块,打造沉浸式视觉体验;教育机构采用「历史场景复原」方案,让历史遗迹在虚拟空间中重现。测试数据显示,使用Stable Virtual Camera的视图合成效率提升5倍,场景一致性评分达到94.7%,循环视频无缝度提升至99.2%。

开源生态与学术影响

作为专注于研究与非商业用途的开源模型,Stable Virtual Camera在GitHub发布首月即获得8K星标,研究社区已贡献200+论文引用。其API支持Python调用,提供从单视图到多视图合成的全系列工具。与Blender、Unity等平台的深度整合,使研究流程更加高效。学术版提供详细技术文档与案例库,日均处理生成请求超50万次。

Stable Virtual Camera不仅是一个工具,更是3D视图合成的里程碑。立即体验,感受虚拟相机的强大能力,让每个视角都成为探索世界的窗口。未来已来,视界无界——Stable Virtual Camera助您开启3D合成的新篇章!